角色.ai突破技术:视频联系实时AI角色

发布时间:2025-07-08 09:39

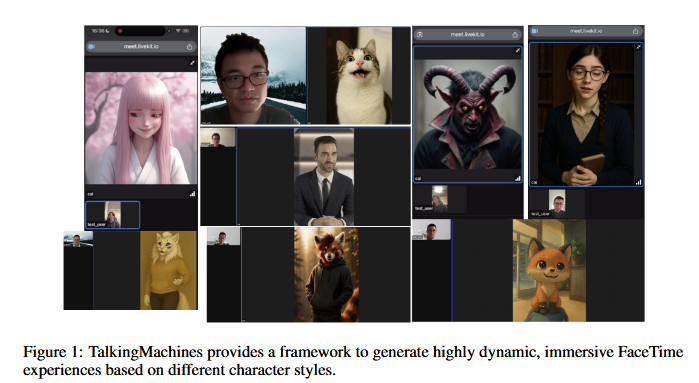

Home 7月5日新闻AI Chatbot.ai的角色平台发布了演示纸和视频演示,显示了一种称为TalkingMachines的自回归扩散模型,这使AI角色与之互动更为现实。该模型不再部署到字符。根据研究论文和视频演示,用户只需要输入图片和声音信号,该模型就可以像视觉触点一样实现FaceTime。基于变压器(DIT)扩散技术,该模型本质上是一种“艺术家”,可以从随机噪声中创建详细的图像,并继续优化图像以完美。角色的作用。AAI使此过程非常快,并实现了实时结果。说话的牙龈模型口香糖,牙龈胶囊,包括适用于流动的扩散,诸如音频,稀疏注意和不对称的注意力的扩散。其中,与扩散相对应的流我的性格动作可确保通过练习大量动作,包括轻度的面部表情和更大的行为来确保它更自然。音频驱动的技术不仅允许听单词,而且可以理解节奏,停止和音频语调,并将其转化为准确的嘴唇形状,点头和眨眼。患者注意力技术允许角色ai以更好的方式处理视频帧,而命令不对称允许视频实时发展,从而创造出效果的FaceTime。角色ai强调,这项研究中的突破不仅与面部动画有关,而且是迈向实时交互式音频视觉AI角色的一步。该模型支持各种样式,例如真实的人,动漫和3D虚拟图像。参考参考有房子

Home 7月5日新闻AI Chatbot.ai的角色平台发布了演示纸和视频演示,显示了一种称为TalkingMachines的自回归扩散模型,这使AI角色与之互动更为现实。该模型不再部署到字符。根据研究论文和视频演示,用户只需要输入图片和声音信号,该模型就可以像视觉触点一样实现FaceTime。基于变压器(DIT)扩散技术,该模型本质上是一种“艺术家”,可以从随机噪声中创建详细的图像,并继续优化图像以完美。角色的作用。AAI使此过程非常快,并实现了实时结果。说话的牙龈模型口香糖,牙龈胶囊,包括适用于流动的扩散,诸如音频,稀疏注意和不对称的注意力的扩散。其中,与扩散相对应的流我的性格动作可确保通过练习大量动作,包括轻度的面部表情和更大的行为来确保它更自然。音频驱动的技术不仅允许听单词,而且可以理解节奏,停止和音频语调,并将其转化为准确的嘴唇形状,点头和眨眼。患者注意力技术允许角色ai以更好的方式处理视频帧,而命令不对称允许视频实时发展,从而创造出效果的FaceTime。角色ai强调,这项研究中的突破不仅与面部动画有关,而且是迈向实时交互式音频视觉AI角色的一步。该模型支持各种样式,例如真实的人,动漫和3D虚拟图像。参考参考有房子